La popularidad que cada vez más está teniendo la inteligencia artificial a lo largo y ancho del mundo ha desatado una ola de preocupación entre algunos empresarios y expertos, quienes discuten los riesgos y las implicaciones negativas que podría tener esta tecnología a futuro.

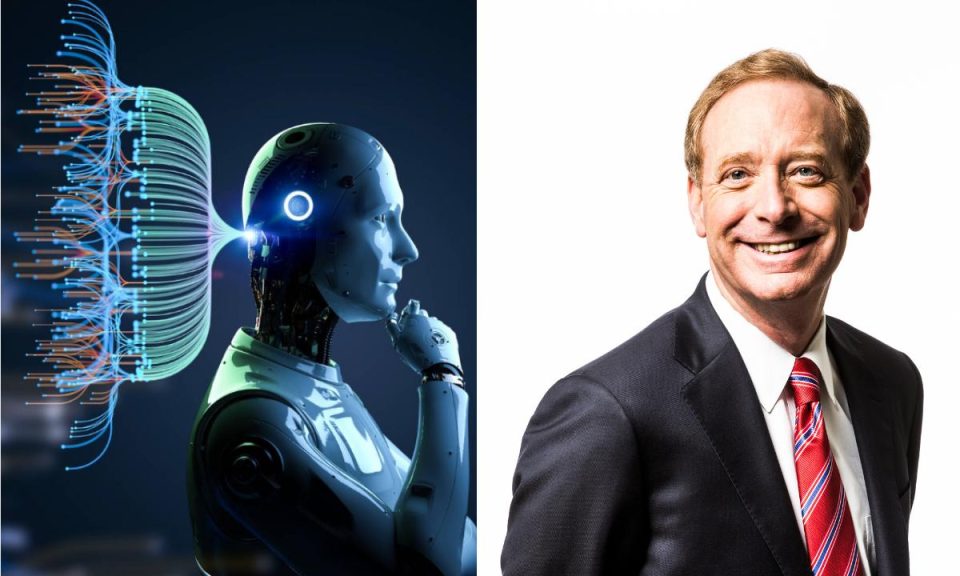

En un discurso que dio el pasado jueves, el empresario y ejecutivo comercial confesó que su mayor temor con respecto a la inteligencia artificial es la falsificación profunda, que contribuye a difundir información errónea.

“Vamos a tener que abordar los problemas relacionados con las falsificaciones profundas. Vamos a tener que abordar en particular lo que nos preocupa de la mayoría de las operaciones de influencia cibernética extranjera, el tipo de actividades que ya están llevando a cabo el gobierno ruso, el chino , los iraníes”, dijo Smith.

Y añadió: “Necesitamos tomar medidas para protegernos contra la alteración de contenido legítimo con la intención de engañar o defraudar a las personas mediante el uso de IA”.

La falsificación profunda o ‘deepfake’ (como es conocido en inglés) utiliza una forma de inteligencia artificial llamada aprendizaje profundo para crear fotos o videos que, aunque parecen reales, no lo son. Su existencia supone una gran preocupación en términos de seguridad, pues no solo se pueden manipular imágenes, sino también voces.

“Un deepfake sería un metraje generado por una computadora que ha sido entrenada a través de innumerables imágenes existentes”, explicó Cristina López , analista senior de Graphika a ‘Business Insider’.

Con el objetivo de regular la inteligencia artificial, Smith abordó la necesidad de expedir licencias que permitan proteger tanto la seguridad física como la ciberseguridad y la seguridad nacional.

“Necesitaremos una nueva generación de controles de exportación, al menos la evolución de los controles de exportación que tenemos, para garantizar que estos modelos no sean robados o utilizados de manera que violen los requisitos de control de exportación del país”, sentenció el presidente de Microsoft.

En un artículo publicado el pasado 25 de mayo, el también abogado dio cinco pautas para gobernar la IA.

– Implementar y aprovechar los nuevos marcos de seguridad de IA liderados por el gobierno.

– Exigir frenos de seguridad efectivos para los sistemas de IA que controlan la infraestructura crítica.

– Desarrollar un amplio marco legal y regulatorio basado en la arquitectura tecnológica para la IA.

– Promover la transparencia y garantizar el acceso académico y sin fines de lucro a la IA.

– Buscar nuevas asociaciones público-privadas para utilizar la IA como una herramienta eficaz para abordar los inevitables desafíos sociales que surgen con la nueva tecnología

(De interés: ChatGPT: creadores lanzan curso gratis para aprender profesión en crecimiento).

Smith no ha sido el único que ha advertido sobre los riesgos de la inteligencia artificial. Hace tan solo unas días atrás, Sam Altman, director ejecutivo de OpenAI, se presentó ante un comité sobre privacidad y tecnología del Senado e hizo un llamado a la regulación de esta industria emergente.

“El gobierno de EE.UU. debería considerar una combinación de requisitos de licencia o registro para el desarrollo y lanzamiento de modelos de IA por encima de un umbral crucial de capacidades, junto con incentivos para el pleno cumplimiento de estos requisitos”, planteó Altman durante su comparecencia.