Los grandes desarrolladores de IA admiten la necesidad de establecer garantías sociales y crean fórmulas para el cumplimiento y seguimiento de la ley. Los ciberactivistas se muestra defraudado

Las grandes empresas de inteligencia artificial aceptan la regulación europea aprobada al filo de la medianoche de este pasado viernes, pero reclaman que no suponga un freno a su desarrollo. Como afirma Pilar Manchón, consejera del comité de asesoramiento del Gobierno español y responsable de estrategia de investigación con inteligencia artificial en Google, “la IA es demasiado importante para no regularla”. Las principales compañías responsables de estos desarrollos han venido trabajando en paralelo a la negociación de la norma para asegurarse una evolución ética de estas herramientas, por lo que la norma coincide con sus expectativas generales siempre que, según advierte Christina Montgomery, vicepresidenta y directora de Privacidad y Confianza de IBM, “proporcione barreras de protección para la sociedad al tiempo que promueve la innovación”.

Hasta ahora, la tendencia de las tecnológicas era dejar en manos de la autorregulación los límites de sus desarrollos. Todas tienen unos principios éticos, que Manchón resume así: “Haz cosas buenas y asegúrate de que va a tener un impacto positivo en la comunidad, en la sociedad, en la comunidad científica. Y, si potencialmente pudiera hacer algo que no es para lo que lo usaste o para lo que lo diseñas, asegurémonos de tomar todas las precauciones necesarias y mitigar los riesgos. Así que: haz solo el bien, innova, sé audaz, pero sé responsable”.

Sin embargo, esta fórmula se ha mostrado absolutamente insuficiente en aspectos como las redes sociales. Según Global Witness, una ONG de investigación y vigilancia del respeto a los derechos humanos con 30 años de trayectoria, “estas empresas prefieren proteger su modelo de negocio lucrativo a la moderación adecuada del contenido y a proteger a los usuarios”.

Para prevenir estas disfunciones con la inteligencia artificial, algunas de las principales empresas e instituciones dan la bienvenida a las normas y proponen fórmulas propias que garanticen el seguimiento de los principios que incluye.

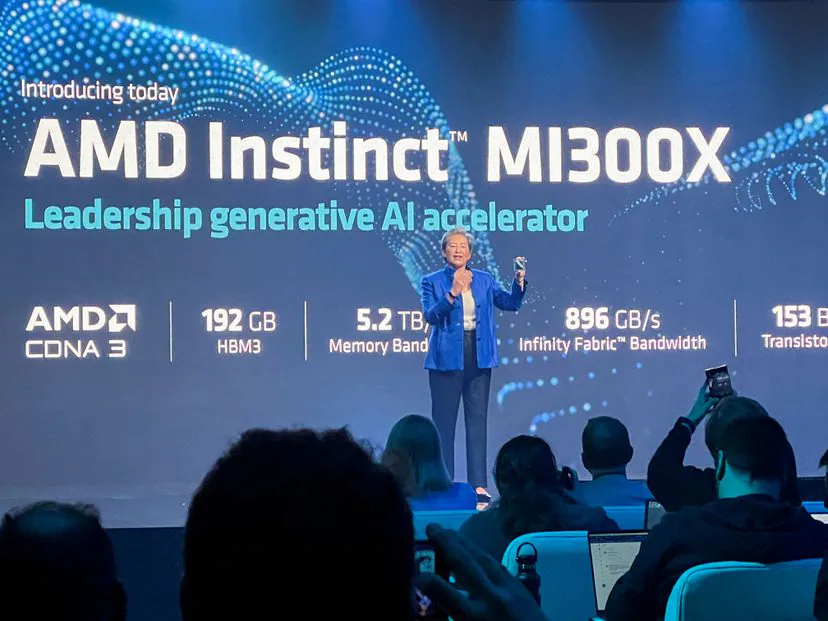

En este sentido, medio centenar de empresas, entre las que se encuentran IBM, Meta, AMD, Intel o Dell; universidades, como Imperial College de Londres, Cornelll, Boston, Yale y Harvard; y entidades como la NASA o la NSF, han formado la Alianza para la Inteligencia Artificial (AI Alliance) para el desarrollo de una IA conforme a las normas: abierta, segura y responsable.

“Una mayor colaboración e intercambio de información ayudará a la comunidad a innovar de manera más rápida e inclusiva, identificando riesgos específicos y mitigándolos antes de lanzar un producto al mundo”, afirman los firmantes. Para ello, sus grupos de trabajo establecerán sus propias normas y se “asociarán” con las iniciativas de los gobiernos y de otras organizaciones. “Este es un momento crucial para definir el futuro de la IA”, advierte Arvind Krishna, presidente de IBM. “Podemos ayudar a garantizar que los beneficios transformadores de la IA responsable estén ampliamente disponibles”, añade Lisa Su, directora general y presidenta de AMD.

De esta forma, los integrantes de la alianza, en la que no figuran por ahora OpenAI, la desarrolladora de ChapGPT, ni Google, que acaba de presentar Gemini (un modelo con capacidades que superan a las de las personas), abogan por la colaboración, entre empresas y con los gobiernos, para seguir una senda común. Como explica Tom Mihaljevic, presidente de Cleveland Clinic, una de las instituciones médicas más avanzadas en el uso de nuevas tecnologías, “las capacidades de IA ahora están en constante crecimiento y mejora y es fundamental que las organizaciones de diversos campos se unan para ayudar a avanzar y, al mismo tiempo, abordar las preocupaciones en torno a la seguridad y la protección”.

También lo defiende Bob Shorten, director de la Escuela de Ingeniería Dyson del Imperial College de Londres: “Creemos que la participación de la comunidad es esencial para que la IA sea confiable, responsable, transparente y auditable”, los principios que defiende la norma europea.

Esta comunidad incluye a los gobiernos, industrias, instituciones académicas e investigadores alineados en un desarrollo ético. Pero, como explica, Manuel R. Torres, catedrático de Ciencia Política de la Universidad Pablo de Olavide y miembro del consejo asesor del Real Instituto Elcano. “El problema es la proliferación de una tecnología que hay que evitar que llegue a la mano incorrecta”.

Torres alaba el papel europeo como “potencia reguladora”, pero advierte: “El conflicto está en cómo se desarrolla esa tecnología en otros ámbitos que no tienen ningún tipo de escrúpulo ni limitación en cuanto al respeto de la privacidad de los ciudadanos cuyos datos alimentan todo eso”.

Pone como ejemplo el caso de China: “No solo está dentro de esa carrera de tecnológica, sino que no tiene ningún tipo de problema en utilizar de manera masiva los datos que dejen sus propios ciudadanos para alimentar y perfeccionar esos sistemas. Por muy escrupulosos que queramos ser con los límites que ponemos a nuestros desarrolladores locales, al final, si esto no se produce de manera global, también es peligroso”.

Wu Zhaohui, viceministro de Ciencia y Tecnología de China, dijo el pasado noviembre, sobre la cumbre de seguridad de inteligencia artificial celebrada en el Reino Unido, que su Gobierno está “dispuesto a aumentar la colaboración para ayudar a construir un marco de gobernanza internacional”.

Pero la legislación, por sí sola, es insuficiente. A partir de la aprobación de la norma europea, la clave será “la supervisión permanente”, añade Cecilia Danesi, abogada especializada en IA y derechos digitales, profesora la Universidad Pontificia de Salamanca y otras universidades internacionales, divulgadora y autora de El imperio de los algoritmos (Galerna, 2023).

Para Danesi, integrante también del grupo Mujeres por la Ética de la Inteligencia Artificial (Women4Ethical AI) de la Unesco, es necesario el seguimiento: “Estos sistemas que son de alto riesgo, que pueden afectar de manera considerable derechos humanos o cuestiones de seguridad. Tienen que ser evaluados y revisados para comprobar que no violan derechos, que no tienen sesgos. Y debe hacerse de forma continuada porque los sistemas, como siguen aprendiendo, pueden adquirir un sesgo. Y actuar de forma preventiva para evitar daños y generar sistemas que sean éticos y respetuosos con los derechos humanos”.

En contra de la regulación del sector en Europa se mostraron 150 directivos de empresas continentales, como Airbus, Ubisoft, Renault, Heineken, Dassault, TomTom, Peugeot y Carrefour. Sus responsables firmaron en junio una carta abierta contra la regulación en la UE al considerar que la norma afectará a “la competitividad y la soberanía tecnológica de Europa sin abordar de manera efectiva los desafíos que enfrentamos y enfrentaremos”.

Ciberativismo

Las ONG y expertos dedicados al ciberactivismo se han mostrado sorprendidos y defraudados con la ley aprobada ayer. Ella Jakubowska, analista especializada en tecnologías de identificación biométricas de la ONG europea en defensa de los derechos digitales EDRi, asegura: “A pesar de muchas promesas, la ley parece destinada a hacer exactamente lo contrario de lo que queríamos. Allanará el camino para que los 27 Estados miembros de la UE legalicen el reconocimiento facial público en vivo. Esto sentará un precedente peligroso en todo el mundo, legitimará estas tecnologías de vigilancia masiva profundamente intrusivas e implicará que se pueden hacer excepciones a nuestros derechos humanos”.

Carmela Troncoso, ingeniera de telecomunicaciones especialista en privacidad en la Escuela Politécnica Federal de Lausana (Suiza), asegura: “Hay muchas prohibiciones muy prometedoras, pero también muchos agujeros y excepciones que no dejan claro que las prohibiciones de verdad vayan a proteger los derechos humanos como esperamos, por ejemplo, que las fuerzas del orden vayan a usar reconocimiento facial en tiempo real para buscar sospechosos. También es triste que España haya estado detrás de algunas de las propuestas más preocupantes de esta ley”, añade Troncoso, creadora de la tecnología que hizo posible las apps de rastreamiento de la covid, informa Manuel González Pascual.